Todo lo que debes saber sobre comunicación efectiva con personas con discapacidad auditiva

La comunicación es una parte fundamental de la experiencia humana. Nos permite conectarnos, expresar nuestras necesidades y emociones, y comprender el mundo que nos rodea. Por eso, es esencial asegurarse de que sea accesible para todas las personas, independientemente de sus habilidades auditivas. Para garantizar una interacción significativa y respetuosa con personas con discapacidad auditiva, es importante comprender sus necesidades y aprender estrategias efectivas de comunicación.

La discapacidad auditiva abarca una amplia gama de niveles de pérdida auditiva, desde una pérdida leve hasta una pérdida profunda o total de la audición. Algunas personas nacen con esta discapacidad, mientras que otras la adquieren a lo largo de su vida. Es clave comprender que la discapacidad auditiva no afecta solo la capacidad de escuchar sonidos, sino que también puede influir en la comunicación verbal y en la comprensión del lenguaje hablado. Cada persona es única, por lo que es esencial adaptar nuestra comunicación según sus necesidades específicas.

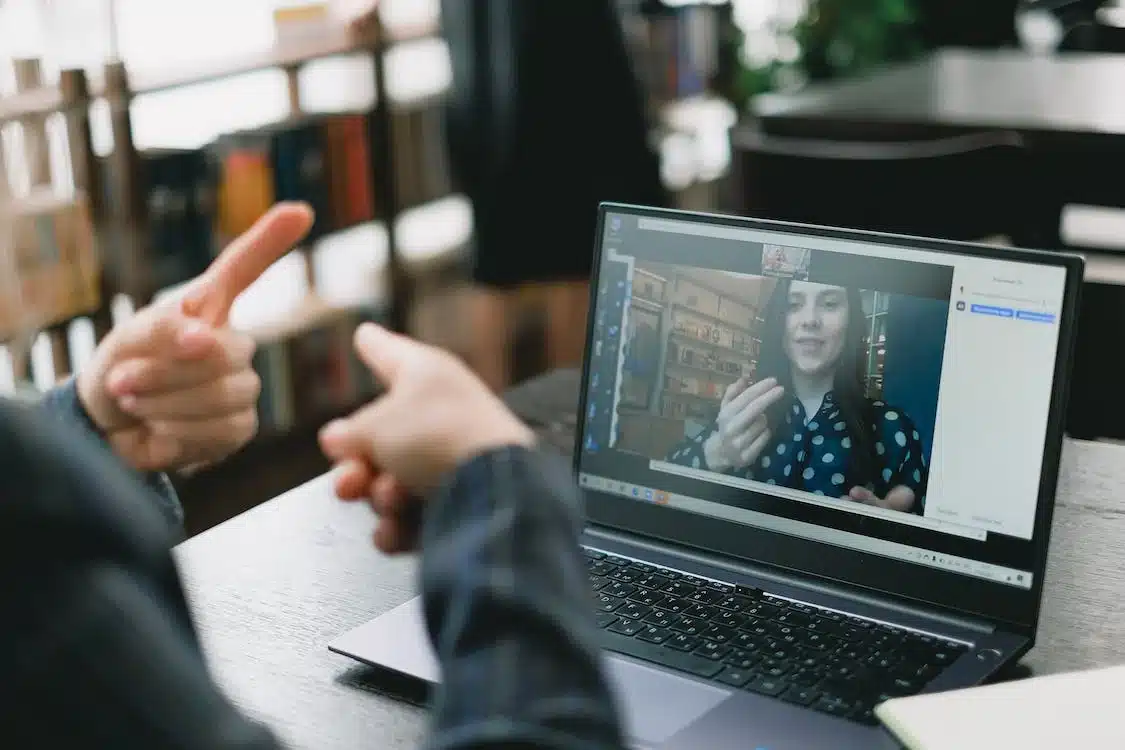

La lengua de señas

Para muchas personas con discapacidad auditiva, el lenguaje de señas es una herramienta crucial de comunicación. Cada país y región puede tener su propio lenguaje de señas, lo que refleja la diversidad de las culturas sordas en todo el mundo. Tomarse el tiempo para aprender algunas señas básicas puede marcar una gran diferencia al interactuar con personas sordas.

Comunicación oral

Algunas personas con discapacidad auditiva utilizan la comunicación oral y dependen de la lectura de labios para comprender las conversaciones. Cuando te comunicas con alguien que lee los labios, es importante hablar de manera clara y sin apresurarse. Evita cubrir tu boca o comer mientras hablas, ya que esto dificulta la lectura labial.

Tecnología y ayudas técnicas

La tecnología ha revolucionado la forma en que las personas con discapacidad auditiva pueden comunicarse. Los dispositivos como los audífonos y los implantes cocleares pueden ayudar a algunas personas a recuperar parte de su capacidad auditiva. Además, los servicios de transcripción en tiempo real y las aplicaciones de comunicación por texto están disponibles para facilitar la comunicación.

La Importancia de preguntar y aprender

Nadie espera que seas experto o experta en la comunicación con personas con discapacidad auditiva, pero mostrar interés y disposición para aprender es valioso. Preguntar a la persona con discapacidad auditiva cuáles son sus preferencias y necesidades de comunicación es un buen punto de partida.

En entornos públicos y privados, es esencial fomentar la inclusión de personas con discapacidad auditiva. Esto incluye proporcionar intérpretes de lenguaje de señas en eventos importantes, utilizar subtítulos en vídeos y películas, y crear un espacio donde todos se sientan cómodos comunicándose de la manera que prefieran.

La comunicación efectiva es una habilidad valiosa en cualquier contexto, pero es aún más significativa cuando se trata de personas con discapacidad auditiva. ¿Qué estrategias encuentras más efectivas? ¡Cuéntanos en los comentarios!